Irán, primera prueba masiva de la guerra asistida por IA

El conflicto actual en Oriente Medio es Primera prueba a gran escala de guerra asistida por IA. Bloomberg Se entrevistó a portavoces del Comando Central de Estados Unidos para evaluar su alcance, hasta qué punto las máquinas toman decisiones y otros aspectos colaterales importantes de la situación actual, como las responsabilidades de los gigantes comerciales en el suministro de la tecnología.

La guerra contra Irán continúa y, como han advertido casi todos los analistas (excepto los facilitadores estadounidenses e israelíes), es terrible. Entre las víctimas humanas (la mayoría de las cuales son civiles), las personas desplazadasprovocando pérdidas económicas e impactos inconmensurables en el mundo y en todos los sectores (incluido el suministro de semiconductores).

también, Las consecuencias son impredecibles. Porque no sucedió tan rápido ni tan quirúrgicamente como predijeron. Escuchar al Comandante en Jefe (Trump) inclinarse hacia un lado y hacia el otro y hacer declaraciones contradictorias mientras las voces en el aire no auguran soluciones a corto plazo a través de altos el fuego y negociaciones para poner fin al conflicto y sentar las bases para aliviar el polvorín en la región.

Proyecto Maven: Inteligencia artificial de clase mundial para la guerra

Pasando a la pregunta actual, explique que hace diez años conocimos el proyecto “Maven”. Un programa del Departamento de Defensa de Estados Unidos, creado con Centro Conjunto de Inteligencia Artificialdestinado a investigar e implementar las últimas tecnologías de inteligencia artificial y aprendizaje automático en entornos militares. El programa fue y sigue siendo controvertido. Cuando un gran grupo de empleados de Google (6.400 firmantes) se rebelaron contra su empresa En una carta abierta, pidieron al gigante de Internet que pusiera fin a su contrato con el Pentágono para proporcionar datos para el proyecto.

La petición de los empleados de Google, apoyada por 300 científicos y académicos (300 expertos en robótica, inteligencia artificial, relaciones internacionales, seguridad, ética y derecho), citaba cuestiones éticas, decisiones políticas y la erosión de la confianza de los usuarios. Si la seguridad ya es una cuestión debatible, también lo son las cuestiones morales. Los científicos que se oponen al Proyecto Maven advierten «Contratos del Departamento de Defensa Envían una peligrosa señal de alianza Una colaboración entre la industria tecnológica privada y el ejército de un país que actualmente posee grandes cantidades de datos personales confidenciales recopilados de todo el mundo..

Google respondió y canceló el contrato, aunque otras empresas, p. Microsoft y Amazon toman el control El proyecto continúa. Un portavoz militar estadounidense confirmó que el Proyecto Maven estuvo activo en combate real después de que los terroristas de Hamás atacaran Israel y devastaran Gaza en octubre de 2023.

La guerra asistida por IA lidera el ataque contra Irán

El portavoz del Comando Central, el capitán Timothy Hawkins, aseguró a Bloomberg que el ejército estadounidense está utilizando herramientas de inteligencia artificial en operaciones en Irán. «No toman decisiones sobre objetivos ni reemplazan a los humanos». Sin embargo, ayudan «Toma mejores decisiones más rápido».

En los últimos años, los ejercicios militares estadounidenses se han centrado en una frase específica: «Mil Decisiones», en la que los comandantes practican el filtrado de un flujo de datos para identificar si 1.000 objetos son amigos o enemigos en una hora. En las primeras 24 horas de la guerra con Irán, Estados Unidos bombardeó 1.000 objetivos.se produjeron una gran cantidad de ataques en tan poco tiempo. El almirante Brad Cooper, comandante del Comando Central, dijo que el ataque fue casi el doble del tamaño del ataque estadounidense contra Irak en 2003.

Hawkins dijo “El ejército sigue procesos estrictos para el uso de inteligencia artificial”consistente con la política, la doctrina militar y la legislación de Estados Unidos. La inteligencia artificial ayuda a los analistas a identificar aspectos clave, generar puntos de interés y facilitar la toma de decisiones para las operaciones de Irán. La IA también ayuda a extraer datos de los sistemas y organizar la información con claridad.

Las tecnologías de inteligencia artificial utilizadas en operaciones contra Irán incluyen sistema inteligente mavenPalantir Technologies Inc. crea una plataforma de control de misión digital, según personas familiarizadas con la empresa estadounidense que pidieron no ser identificadas para evitar revelar información confidencial. La plataforma surgió del Proyecto Maven antes mencionado, un esfuerzo impulsado por DARPA para desarrollar inteligencia artificial en el campo de batalla.

Según las fuentes, uno de los principales modelos de lenguaje instalados en el sistema es la herramienta Claude AI de Anthropic, dijeron. se ha vuelto esencial Participe en las operaciones estadounidenses contra Irán y acelere el desarrollo de Maven. Curiosamente, Anthropic está en el centro de una disputa con el Departamento de Defensa sobre las limitaciones del software y la respuesta del gobierno al considerar Anthropic. ‘Cadenas de suministro en riesgo’una designación generalmente reservada para los adversarios de Estados Unidos.

La compañía ha anunciado que la impugnará ante los tribunales, una decisión que podría trastornar a la compañía y al ejército y dejar indeterminado el futuro de los experimentos de guerra de inteligencia artificial de Estados Unidos.

riesgo y ética

El uso de la inteligencia artificial, o lo que llamamos guerra asistida por IA, es tan criticado como promovido. Detén a los robots asesinosUna coalición de 270 organizaciones de derechos humanos ha cuestionado la estrategia de Irán, argumentando que los sistemas de apoyo a la toma de decisiones basados en inteligencia artificial reducen la brecha entre recomendar y ejecutar ataques. ‘Una delgada línea peligrosa’.

Además, la eficacia de la inteligencia artificial en tales conflictos no está clara. tiempos de nueva york lo prometió la semana pasada Estados Unidos es responsable de las muertes. La escuela primaria Shajarah Tayyebeh en Irán se cobró aproximadamente 175 víctimas, en su mayoría niñas, además de profesores y padres. El New York Times lo atribuyó a “Elecciones equivocadas debido a información desactualizada proporcionada por la IA”.

Decenas de senadores demócratas exigen respuestas de la administración Trump a medida que aumenta la evidencia de que Estados Unidos es responsable. En la carta, más de 45 senadores preguntaron al secretario de Defensa, Pete Hegseth, si Estados Unidos era responsable del ataque y qué análisis previos se habían realizado del edificio. Los senadores también expresaron su preocupación de que el Pentágono haya reducido el personal en una oficina autorizada por el Congreso para reducir las víctimas civiles mientras continúa aumentando las inversiones en inteligencia artificial. El Pentágono dice que está investigando la responsabilidad La peor masacre de civiles en Estados Unidos desde 2003.

¿Dónde terminará todo? ¿Armas autónomas?

El ejército está trabajando para desmitificar las llamadas capacidades de «matar» de los nuevos algoritmos de reconocimiento de objetos, afirmando que cada paso que involucra la inteligencia artificial termina con la verificación humana. El Pentágono ha probado un motor de recomendación de inteligencia artificial que puede sugerir las mejores armas para usar durante los planes y operaciones de ataque. Sin embargo, se informó que los resultados no cumplían con los estándares humanos.

Pero el Departamento de Defensa (y otras autoridades) está dispuesto a seguir adelante. Despliegue de tecnologías “inteligentes” en el campo de batalla. El Pentágono ha comenzado a integrar grandes modelos de lenguaje (LLM) en la toma de decisiones de combate real. Éste será un salto decisivo del que ciertamente no podremos dar marcha atrás.

En los últimos años, la inteligencia artificial ha logrado grandes avances en muchos campos. Algunos tienen grandes esperanzas, como aquellos en la investigación médica que resuelven problemas complejos desarrollando algoritmos avanzados para encontrar tratamientos para enfermedades. Otros son terribles, muy terribles.como los relacionados con armas autónomas y robots soldados.

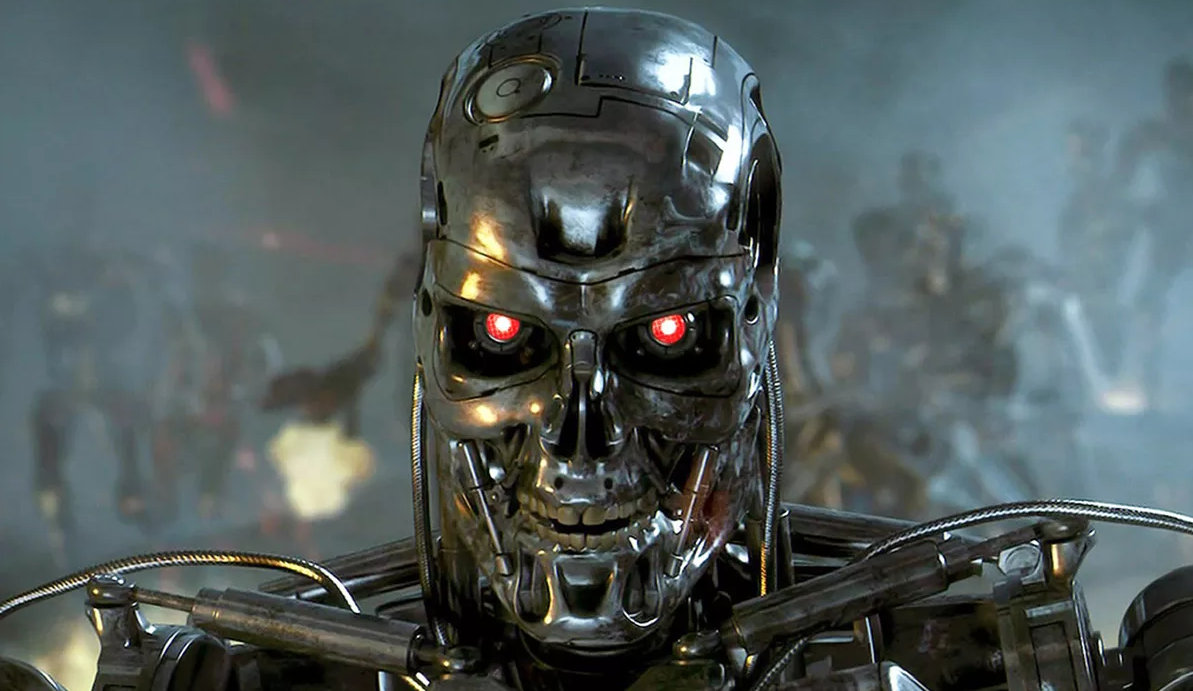

La inteligencia artificial no dejará de aprender y crecer, advierten los medios críticos, y hoy estamos más cerca que ayer del resultado descrito en la película de ciencia ficción de Cameron «The Terminator». Muchas voces autorizadas siguen lanzando advertencias falta de control (Técnico, legal, ético y seguridad) Todo lo relacionado con la inteligencia artificial.

Expertos en tecnología e inteligencia artificial firman una carta abierta y una petición a las Naciones Unidas El uso de armas autónomas quedará completamente prohibido.. ¿Deberíamos desarrollar mentes subhumanas que eventualmente puedan superarnos en número, ser más astutas, volvernos obsoletos y reemplazarnos? ¿Deberíamos arriesgarnos a perder el control de nuestra civilización?quieren saber.

Desafortunadamente, la primera prueba a gran escala de guerra asistida por inteligencia artificial de Irán es un anticipo de lo que vendrá. Al mundo le falta más “sabiduría humana”.

Puedes consultar la fuente de este artículo aquí